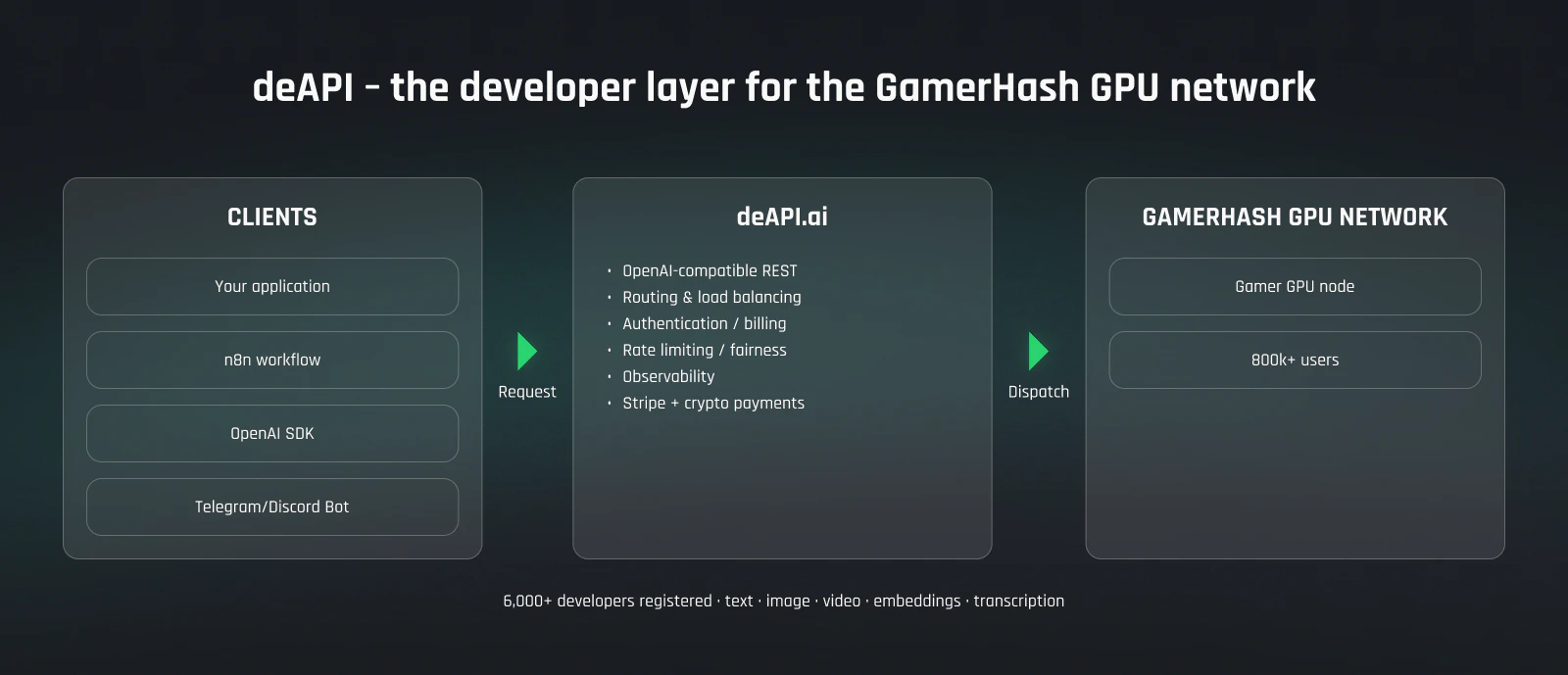

GPU 기여자는 하드웨어를 굴리고, 게이머는 부수적으로 보상을 받습니다. AI 빌더는 네트워크의 반대편에서 컴퓨팅을 소비하는 쪽입니다. 사용하는 제품은 deAPI — 어떤 애플리케이션, 워크플로, 봇에서도 호출 가능한 OpenAI 호환 REST 엔드포인트입니다.Documentation Index

Fetch the complete documentation index at: https://docs.gamerhash.com/llms.txt

Use this file to discover all available pages before exploring further.

누구에게 맞는 가이드인가

- 채팅, 이미지, 비디오 생성을 제품에 붙이는 앱 개발자.

- 워크플로 안에서 저렴하고 프라이빗한 추론이 필요한 n8n / 자동화 운영자.

- 클라우드 비용 부담 없이 백엔드를 갖추고 싶은 인디 개발자와 에이전시.

- 온체인 로직과 오프체인 AI 컴퓨팅을 함께 다루는 Web3 팀.

제공되는 것

- OpenAI 호환 REST — OpenAI SDK를 이미 쓰는 코드에 그대로 끼울 수 있습니다.

base_url과 API 키만 바꾸면 됩니다. 채팅 컴플리션, 스트리밍, 응답 포맷이 모두 동일합니다. - 멀티모달 커버리지 — text-to-image, image edit, image / text / audio → video, 음성(TTS + 음성 인식), text-to-music, OCR, 임베딩. 인증 정보 하나로 모든 모델 클래스를 호출합니다.

- 공식 n8n 노드 — API 코드 한 줄 짜지 않고도 어떤 n8n 워크플로에서든 네트워크를 호출할 수 있습니다.

- 라우팅과 페일오버를 알아서 처리 — deAPI가 사용 가능한 GPU로 디스패치하고, 일시적 실패는 재시도, 모델 적합도에 맞춰 부하를 분산합니다.

- 투명한 비용 구조 — 모델별 가격, 실시간 사용량 대시보드, 예산 관리 기능까지.

중앙집중식 클라우드 대신 deAPI를 쓰는 이유

- 비용 구조 — 평소엔 놀고 있던 컨슈머 GPU에서 워크로드가 돌아갑니다. 하이퍼스케일러와는 단위 경제 자체가 다릅니다.

- 오픈소스 모델 — Flux, LTX-Video, Qwen, Whisper, ACE-Step 등에서 골라 쓸 수 있습니다. 특정 벤더 락인이나 모델별 사일로 레이트 리밋이 없습니다.

- 프라이버시 — 콘텐츠는 처리 후 폐기됩니다. 정산이 끝난 뒤 네트워크가 프롬프트나 결과를 보관하지 않습니다.

- 돈이 실제 사람에게 흘러갑니다 — 지출이 하이퍼스케일러 마진이 아니라 GPU를 굴리는 기여자에게 갑니다.

알아둘 트레이드오프

- 레이턴시 — 컨슈머 GPU는 단일 데이터센터에 모여 있지 않습니다. 첫 토큰까지의 지연 시간은 중앙집중식 클라우드보다 길고, 콜드 스타트 워크로드에서는 특히 차이가 납니다.

- 모델 가용성 — 카탈로그는 큐레이션되어 꾸준히 늘어나지만 무한하지는 않습니다. 니치하거나 폐쇄된 모델은 제공되지 않을 수 있습니다.

- 용량 — 피크 수요 시간대에는 큐 시간이 늘 수 있습니다. 표준 레이트 리밋이 적용됩니다.

흐름은 이렇게

deAPI 요청은 게이트웨이로 들어가 인증과 과금을 거친 뒤, AI App을 돌리는 기여자 머신 네트워크로 디스패치됩니다. 거쳐 가는 모든 비용은 플랫폼 인프라와 **기여자 직접 보상(GUSD)**으로 나뉩니다. 게이머와 전용 GPU 기여자에게 보상이 흘러가는 그 루프와 똑같습니다.시작하기

deAPI 웹사이트

가입, 키 발급, 실시간 사용량 확인.

GPU 기여자

네트워크의 반대편 — 호출하는 작업을 누가 처리하는지.